— Мам, привет! Слушай, меня хозяйка квартиры хочет выставить с вещами на улицу за то, что я задержала оплату. Помоги, пожалуйста, одолжи 20 тысяч, чтобы она отстала.

— Саш, привет! Выручи, пожалуйста, по-родственному. Я в больнице, меня госпитализировали срочно и нужно прямо сейчас сделать МРТ. Можешь занять 5 тысяч? Только у меня карта новая, я скину номер. Как выпишут, верну.

Жители Волгограда привыкли слышать подобные вещи по телефону от мошенников, которые пытаются имитировать голос родных и знакомых. Но злоумышленникам больше не нужно напрягать свои связки — они научились действовать убедительнее: подделывать голос и даже изображение любого человека с помощью современных технологий. Теперь им под силу присылать аудиосообщения от имени наших близких с их голосами, а также создавать видеосообщения с их сгенерированными лицами, чтобы заработать на человеческой невнимательности и доверчивости. Разбираемся, как распознать дипфейк и не стать жертвой мошенника в попытке помочь родному человеку.

Накатанные схемы уже не в моде, но работают

По данным Центрального Банка РФ, в 2023 году злоумышленникам удалось украсть у россиян 15,8 миллиарда рублей. И несмотря на давно известные ухищрения и методы мошенников, самые наивные из граждан продолжают попадаться на крючок.

Так, пенсионерка из Тюмени продала квартиру и отдала 12 миллионов рублей телефонным аферистам, убедившим ее перевести свои сбережения из якобы небезопасного банка на новый счет. Позднее, прямо на глаза у журналистов пожилая женщина решила отправить неизвестным еще одну крупную сумму денег.

В свою очередь, волгоградец стал жертвой фейковой экскортницы и перевел злоумышленнику с женским голосом 97 000 рублей. Мошенником оказался житель Пензенской области, продающий несуществующие эротические услуги, имитируя голос проститутки и выбивающий с «клиентов» дополнительные средства.

На смену таким незатейливым, но эффективным схемам обмана, приходят современные технологии, с возможностями которых знаком далеко не каждый простой человек. Зато злоумышленники уже успели изучить и опробовать для совершения преступлений такие новейшие разработки, как нейросети.

Даже начинающие мошенники могут быть опасны

Нейросети могут облегчить работу специалистам практически любой сферы, а значит, и автоматизировать часть действий киберпреступников. Растущий интерес среди злоумышленников к широким возможностям нейросетей выявили и эксперты по информационной безопасности. Аналитик «Лаборатории Касперского» Алиса Кулишенко рассказала, чем чат-боты могут быть полезны для мошенников.

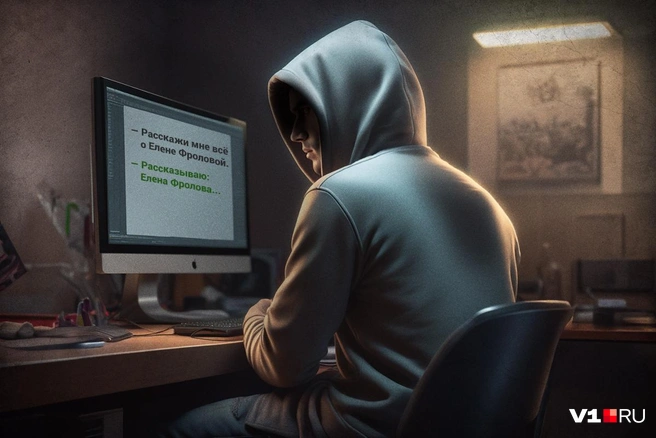

— На теневых ресурсах мы наблюдаем обсуждения использования нейросетей для различных вредоносных действий, — рассказывает аналитик. — Чтобы избежать этого, разработчики встраивают различные механизмы защиты. А злоумышленники, чтобы избежать их, формируют специальные запросы — джилбрейки. Много теневых площадок даркнета существуют в формате форумов, — поделилась Алиса Кулишенко. — Возможно, это и есть модели, разработанные злоумышленниками для совершения своих действий. Раньше была нужна коммуникация между человеком и мошенником, но сейчас часть запросов может быть получена автоматически. Даже начинающие злоумышленники могут представлять угрозу за счет получения компетенции от языковых моделей.

Искусственный интеллект дает неограниченные возможности злоумышленникам создавать новые способы наживы над простым интернет-пользователем. И аферисты по максимуму экспериментируют с технологическими разработками.

— Мы нашли на одном из даркнет-форумов обсуждения утилитов, использующиеся для ухода от антивирусных или защитных решений, они могут использоваться и при проведении полноценных атак. Используются они и для создания вредоносных ПО, — утверждает эксперт в области интернет-безопасности. — Уже существуют модели, изначально содержащие в себе вредоносный функционал, это: WormGPT, FraudGPT и прочие. Каждый месяц появляются новые и становятся всё более распространены и позиционируются как аналоги ChatGPT, но сразу со снятыми ограничениями.

Угроза чат-ботов заключается в их способности генерирования фишинговых сообщений и разработке вредоносных ПО и задач. Какие еще инструменты нейросетей можно использовать для зловредных целей, подробнее рассказал руководитель группы исследований и разработки технологий машинного обучения «Лаборатории Касперского» Владислав Тушканов.

— С помощью нейросетей можно автоматизировать деятельность злоумышленников: написание писем, обращение к людям в мессенджерах, автоматизация ботов в соцсетях, генерирование вредоносных кодов, — поделился эксперт. — Нейросети могут генерировать и изображения, дипфейк-видео, голосовые сообщения, которые могут использоваться в мошенничестве. Например, для завлечения человека нажать на какую-то ссылку, чтобы тот скачал вредоносный файл и так далее.

Под удар попал даже мэр Марченко

Искусство создания дипфейковых видео изучили не только мошенники, но и авторы волгоградских телеграм-каналов. Не так давно широкое распространение в сети получили несколько сгенерированных видео с использованием лица мэра Волгограда Владимира Марченко, в которых он предстает в образах героев известных фильмов и рэперов.

В одном из творений автора канала, мэр выглядит как известный рэпер Эминем и танцует в клипе на песню Without Me. В следующем — играет роль Уильяма Уоллеса в известном фильме «Храброе сердце». Накануне в канале показали Владимира Марченко в роли крестного отца.

Стоит отметить, что лицо чиновника отлично вписывается в образы персонажей, а сами видео выполнены далеко не в худшем качестве. Свое мнение по поводу сгенерированного видео с использованием лица главы города высказал анонимный источник из мэрии Волгограда.

— Дипфейки используются в двух направлениях: для фальсификации и для сферы искусства и развлечений. То, что сделано с лицом Владимира Марченко, можно отнести скорее ко второму направлению, — говорит сотрудник администрации города. — Искусство высокое или низкое непонятно, но ясно, что это больше дружеский шарж, чем попытка ввести в заблуждение аудиторию. И если рассматривать это как элемент искусства, то для выбора кандидатуры в этих целях необходимо для фактора: узнаваемость героя, чье лицо применяется в дипфейке, и достаточное количество разных изображений для того, чтобы искусственный интеллект смог с ними работать.

Собеседник редакции уверен, что выбор Владимира Марченко для создания таких видео, объясняется его узнаваемостью и популярностью среди жителей Волгограда и пользователей соцсетей. Однако отдельные волгоградцы в комментариях под публикацией этих дипфейков неоднократно писали о том, что не знают человека, чье лицо использовано в видео. И получая ответ на вопрос о герое дипфейка, искренне радовались, ведь наконец узнали, как выглядит глава Волгограда. И ни горожанам, ни представителям властей не стоит беспокоиться, когда подобный контент несет лишь положительный характер.

— Но чисто теоретически наверняка как любой публичный политик он при необходимости будет готов принять меры к вбросам, — рассуждает представитель мэрии города. — Если они будут сделаны злоумышленниками для какой-то деструктивной цели.

Героем подобного дипфейка развлекательного формата стал и бывший глава Тракторозаводского района, политолог, историк и знаменитый полемист Михаил Серенко. На опубликованных в телеграм-канале правозащитника и активиста Алексея Ульянова видео политолог якобы поет известные хиты. Лицо этой публикации — Михаил Серенко — рассказал, почему не воспринимает такие посты в негативном ключе и почему в стране до сих пор распространено мошенничество.

— Если это делается друзьями, а автор видео — мой друг Алексей Ульянов, здесь скрывать нечего, то я только положительно отношусь. Это дружеский прикол. Как отличить умного человека от глупого: у первого развита самоирония, обижаются дураки, — поделился Михаил Серенко. — Другое дело, что такие функции искусственного интеллекта сейчас часто используют мошенники. И я придерживаюсь той точки зрения, что если какой-то вид преступления не могут пресечь, то нужно искать погоны, стоящие за этим видом преступления. Если бы силовики захотели, то давно бы прекратились все эти разводы бабушек, использования искусственного интеллекта, но, видимо, пока не хотят приложить достаточно усилий, чтобы это пресечь.

По мнению волгоградского полемиста, чтобы минимизировать количество подобных преступлений, необходимо ужесточить меры уголовного наказания.

— Почему у нас часто утекают данные? Потому что срок маленький дают, а вы дайте пожизненный срок за утечку базы данных, они перестанут. Здесь вопрос не в искусственном интеллекте, от него мы никуда не денемся, со временем, в какой-то степени он всех заменит, — рассуждает Михаил Серенко. — Но надо понимать, что в руках преступников это оружие. Даже без этих дипфейковых видео мошенники совершают такие виды преступлений, что волосы на голове дыбом встают. Например, взять какой-то кредит, это сложно, но мошенники с легкостью их оформляют. Любое благое начинание мошенники будут использовать против людей, то же самое и с нейросетями.

Как защитить себя от дипфейков?

Часто злоумышленники пользуются одной из главных уникальных функций нейросетей — генерированием несуществующих в реальности видео, аудио и изображений, в попытках обмануть не самую внимательную жертву. Специалист «Лаборатории Касперского» Владислав Тушканов рассказал, как можно опознать фейковое видео, чтобы не попасть в ловушку мошенника.

— Что касается дипфейковых видео, раньше их можно было распознать по отсутствию моргания у людей. Сейчас лучше смотреть на овал лица, — объяснил специалист «Лаборатории Касперского». — И рассматривать видео покадрово, искать дефекты на лице. Есть технологии, которые помогают наложить маску лица на время звонка. При видеозвонке, например, можно попросить человека повернуться в профиль. Но что в основном делают мошенники: берут самую дешевую камеру, заходят в самую темную комнату, напротив монитора и действуют.

Значительно лучше у мошенников отточены навыки создания фейковых голосовых сообщений, но при должном внимании распознать их не составит труда.

— Они умеют копировать тембры, интонации. Но части просодики, паузы и манеризмы нет. Поэтому уже после двух предложений, сказанных мошенником, всё будет понятно, — утверждает Владислав Тушканов. — Чтобы убедиться, достаточно всегда просто перезвонить человеку. С подозрительной текстовой информацией куда проще, нужно просто искать подтверждающие эту информацию факты в нескольких источниках и не принимать сразу каких-то решений, основываясь на полученном вами текст.

Личные данные остаются в интернете навсегда

Создание дипфейков, фишинговых ссылок и вредоносных ПО — не единственная полезная для хакеров функция искусственного интеллекта. Нередко и сам человек предоставляет им неограниченные возможности для совершения на себя атак. Руководитель ЦУР Волгоградской области Олег Егорушин рассказал о том, что позволяет злоумышленнику воровать данные с помощью чат-ботов.

— Мошенники могут действовать через нейросети, по запросам, воровать ваши данные. К сожалению, не все мы соблюдаем безопасность относительно того, что пишем, публикуем, пересылаем в личных сообщениях и так далее, — рассказывает Олег Егорушин. — А всё это видно, есть множество сайтов-клонов. И даже если я зачистил во «ВКонтакте» свои фотографии, которые выкладывал пятнадцать лет назад, то на сайтах-клонах они хранятся до сих пор. Найти всё это не составит злоумышленнику никакого труда. Даже если вы в переписке отправляли сообщения со своими личными данными, это всё остается в сети, и мошенник может это всё вытащить.

По словам руководителя ЦУР Волгоградской области, нейросети могут помочь злоумышленнику сгенерировать любой код, программу, которая вытащит с гаджета пользователя все личные данные.

Когда вы разрешите какому-то приложению доступ к вашим фотографиям и данным, мошенники автоматом смогут это всё отгружать по ключевым фразам, по фото, — объясняет Олег Егорушин. — Они же понимают, что если на каком-то изображении находится, например, герб, то значит это что-то важное, нужно забрать. Но что с нейросетями, что без них, мошенникам легко действовать, если вы не соблюдаете безопасность. Информацию, которой вы сами делитесь с сетью, зачистить уже никак не получится. Всё, что попало в интернет, оставляет за собой цифровой след, и неважно, личная это переписка или какая-то публикация. Поэтому безопасность человека только в его руках.

К слову, не все злоумышленники стараются облегчить себе свою работу, воруя личные данные человека и создавая фейковые материалы с его участием с помощью нейросетей. Особо хитрые из них совершенствуют свои навыки в области психологии и получают прибыль, воздействуя на эмоции потенциальных жертв. В связи с этим возник новый вид мошенничества — попрошайничество в социальных сетях под видом нуждающихся в смеси для кормления мамочек.